실제 문제를 해결하기 위해서는 많은 횟수를 반복하여 학습하는 것이 필요하다.

따라서 중간중간 학습시킨 파라미터를 저장하고, 이를 불러와 이어서 학습을 진행하는 것이 필수적이다.

TensorFlow 2.0에선 tf.train.CheckpointManager를 제공해주어 이 과정을 따를 수 있다.

[파라미터를 저장하는 법]

① tf.train.Checkpoint 클래스의 인자값으로 저장하고자 하는 tf.keras.Model 인스턴스와 전역 반복횟수를 지정해서 선언

ckpt = tf.train.Checkpoint(step=tf.Variable(0), model=CNN_model)

="전역 반복횟수는 0부터 시작, tf.keras.Model 인스턴스에 있는 CNN_model을 사용하겠다"

② tf.train.CheckpointManager에 인자값으로 선언한 tf.train.Checkpoint 인스턴스와 중간 파라미터를 저장할 경로 설정

ckpt_manager = tf.train.CheckpointManager(ckpt, directory=SAVER_DIR, max_to_keep=5)

="ckpt 인스턴스를 사용할 것이며, 저장할 경로는 SAVER_DIR이고 최근 5개의 학습 결과를 저장할 것이다."

③ 파라미터를 저장하고자 하는 시점에 해당 시점의 전역 반복횟수를 인자값으로 선언한 tf.train.CheckpointManager의 save 메소드를 호출

ckpt_manager.save(checkpoint_number=ckpt.step)

="전역 반복횟수를 저장"

④ tf.train.Checkpoint의 전역 반복 횟수 값(ckpt.step)을 매 반복마다 1씩 증가시킴

ckpt.step.assign_add(1)

="전역 반복횟수 1씩 증가"

[파라미터를 불러오는 법]

① tf.train.latest_checkpoint의 인자값으로 파라미터가 저장된 폴더 경로를 지정해서 가장 최근의 체크포인트 파일의 경로(full path)를 가져옴

latest_ckpt = tf.train.latest_checkpoint(SAVER_DIR)

② 선언한 tf.train.CheckpointManager의 restore 함수의 인자값으로 불러올 체크포인트 파일의 경로를 지정해서 파라미터 값을 복원

ckpt.restore(latest_ckpt)

# -*- coding: utf-8 -*-

# CNN을 이용한 MNIST 분류기 - tf.train.CheckpointManager API 예제 - Keras API를 이용한 구현

import tensorflow as tf

# MNIST 데이터를 다운로드

(x_train, y_train), (x_test, y_test) = tf.keras.datasets.mnist.load_data()

# 이미지들을 float32 데이터 타입으로 변경

x_train, x_test = x_train.astype('float32'), x_test.astype('float32')

# 28*28 형태의 이미지를 784차원으로 flattening

x_train, x_test = x_train.reshape([-1, 784]), x_test.reshape([-1, 784])

# [0, 255] 사이의 값을 [0, 1]사이의 값으로 Normalize

x_train, x_test = x_train / 255., x_test / 255.

# 레이블 데이터에 one-hot encoding을 적용

y_train, y_test = tf.one_hot(y_train, depth=10), tf.one_hot(y_test, depth=10)

# tf.data API를 이용해서 데이터를 섞고 batch 형태로 가져옴

train_data = tf.data.Dataset.from_tensor_slices((x_train, y_train))

train_data = train_data.repeat().shuffle(60000).batch(50)

train_data_iter = iter(train_data)

# tf.keras.Model을 이용해서 CNN 모델을 정의

class CNN(tf.keras.Model):

def __init__(self):

super(CNN, self).__init__()

# 첫번째 Convolution Layer

# 5x5 Kernel Size를 가진 32개의 Filter를 적용

self.conv_layer_1 = tf.keras.layers.Conv2D(filters=32, kernel_size=5, strides=1, padding='same', activation='relu')

self.pool_layer_1 = tf.keras.layers.MaxPool2D(pool_size=(2, 2), strides=2)

# 두번째 Convolutional Layer

# 5x5 Kernel Size를 가진 64개의 Filter를 적용

self.conv_layer_2 = tf.keras.layers.Conv2D(filters=64, kernel_size=5, strides=1, padding='same', activation='relu')

self.pool_layer_2 = tf.keras.layers.MaxPool2D(pool_size=(2, 2), strides=2)

# Fully Connected Layer

# 7x7 크기를 가진 64개의 activation map을 1024개의 특징들로 변환

self.flatten_layer = tf.keras.layers.Flatten()

self.fc_layer_1 = tf.keras.layers.Dense(1024, activation='relu')

# Output Layer

# 1024개의 특징들(feature)을 10개의 클래스-one-hot encoding으로 표현된 숫자 0~9-로 변환

self.output_layer = tf.keras.layers.Dense(10, activation=None)

def call(self, x):

# MNIST 데이터를 3차원 형태로 reshape함. MNIST 데이터는 grayscale 이미지기 때문에 3번째차원(컬러채널)의 값은 1임

x_image = tf.reshape(x, [-1, 28, 28, 1])

# 28x28x1 -> 28x28x32

h_conv1 = self.conv_layer_1(x_image)

# 28x28x32 -> 14x14x32

h_pool1 = self.pool_layer_1(h_conv1)

# 14x14x32 -> 14x14x64

h_conv2 = self.conv_layer_2(h_pool1)

# 14x14x64 -> 7x7x64

h_pool2 = self.pool_layer_2(h_conv2)

# 7x7x64(3136) -> 1024

h_pool2_flat = self.flatten_layer(h_pool2)

h_fc1 = self.fc_layer_1(h_pool2_flat)

# 1024 -> 10

logits = self.output_layer(h_fc1)

y_pred = tf.nn.softmax(logits)

return y_pred, logits

# cross-entropy 손실 함수를 정의

@tf.function

def cross_entropy_loss(logits, y):

return tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(logits=logits, labels=y))

# 최적화를 위한 Adam 옵티마이저를 정의

optimizer = tf.optimizers.Adam(1e-4)

# 최적화를 위한 function을 정의

@tf.function

def train_step(model, x, y):

with tf.GradientTape() as tape:

y_pred, logits = model(x)

loss = cross_entropy_loss(logits, y)

gradients = tape.gradient(loss, model.trainable_variables)

optimizer.apply_gradients(zip(gradients, model.trainable_variables))

# 모델의 정확도를 출력하는 함수를 정의

@tf.function

def compute_accuracy(y_pred, y):

correct_prediction = tf.equal(tf.argmax(y_pred,1), tf.argmax(y,1))

accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))

return accuracy

# Convolutional Neural Networks(CNN) 모델을 선언

CNN_model = CNN()

# tf.train.CheckpointManager를 이용해서 파라미터를 저장

SAVER_DIR = "./model"

ckpt = tf.train.Checkpoint(step=tf.Variable(0), model=CNN_model)

ckpt_manager = tf.train.CheckpointManager(

ckpt, directory=SAVER_DIR, max_to_keep=5)

latest_ckpt = tf.train.latest_checkpoint(SAVER_DIR)

# 만약 저장된 모델과 파라미터가 있으면 이를 불러오고 (Restore)

# Restored 모델을 이용해서 테스트 데이터에 대한 정확도를 출력하고 프로그램을 종료

if latest_ckpt:

ckpt.restore(latest_ckpt)

print("테스트 데이터 정확도 (Restored) : %f" % compute_accuracy(CNN_model(x_test)[0], y_test))

exit()

# 10000 Step만큼 최적화를 수행

while int(ckpt.step) < (10000 + 1):

# 50개씩 MNIST 데이터를 불러옴

batch_x, batch_y = next(train_data_iter)

# 100 Step마다 training 데이터셋에 대한 정확도를 출력하고 tf.train.CheckpointManager를 이용해서 파라미터를 저장

if ckpt.step % 100 == 0:

ckpt_manager.save(checkpoint_number=ckpt.step)

train_accuracy = compute_accuracy(CNN_model(batch_x)[0], batch_y)

print("반복(Epoch): %d, 트레이닝 데이터 정확도: %f" % (ckpt.step, train_accuracy))

# 옵티마이저를 실행해 파라미터를 한스텝 업데이트

train_step(CNN_model, batch_x, batch_y)

ckpt.step.assign_add(1)

# 학습이 끝나면 테스트 데이터에 대한 정확도를 출력

print("정확도(Accuracy): %f" % compute_accuracy(CNN_model(x_test)[0], y_test))

위 코드는 앞서 진행했던 MNIST 숫자분류를 위한 CNN 모델 실습 코드와 거의 유사하며 여기에 checkpoint 기능만 추가한 것이다.

https://these-dayss.tistory.com/139

TensorFlow 2.0을 이용한 MNIST 숫자분류를 위한 CNN 구현

# -*- coding: utf-8 -*- # Convolutional Neural Networks(CNN)을 이용한 MNIST 분류기(Classifier) - Keras API를 이용한 구현 import tensorflow as tf # MNIST 데이터를 다운로드 (x_train, y_train), (x_test..

these-dayss.tistory.com

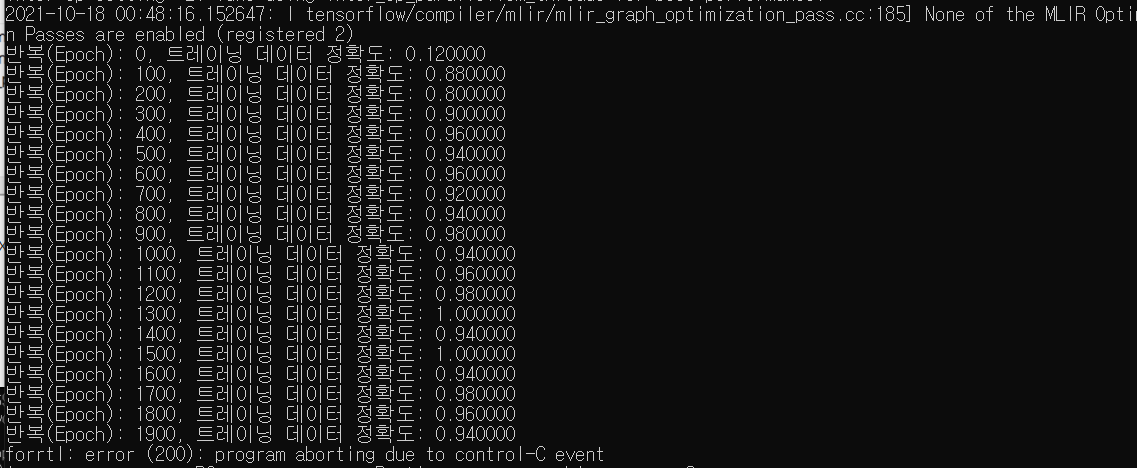

실행 결과, model 폴더가 생성되며, 100번의 학습마다 파라미터 저장 파일들이 생성되었음을 알 수 있고,

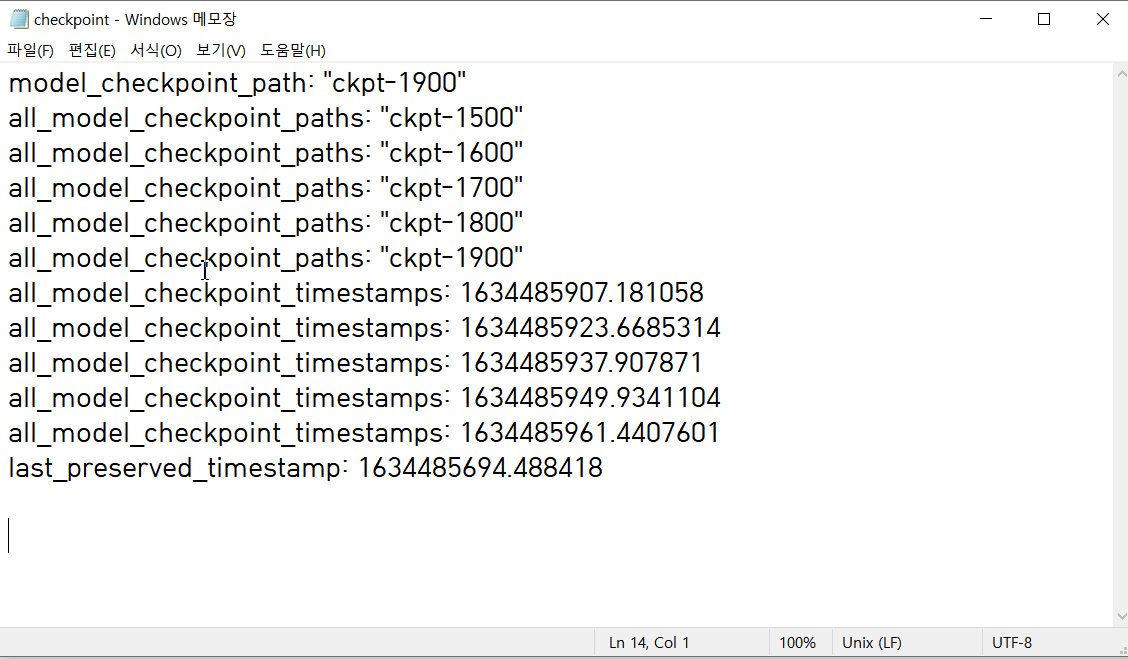

1900번 정도의 학습까지만 시키고 끝냈기 때문에 1500부터 1900까지의 학습 파라미터가 저장된 것을 확인할 수 있다.

(최근 5번의 학습결과)

checkpoint라는 이름의 text 파일도 생성되는데, 여기에는 반복횟수에 대한 메타정보 등이 key-value 형태로 들어가 있다.

# 만약 저장된 모델과 파라미터가 있으면 이를 불러오고 (Restore)

# Restored 모델을 이용해서 테스트 데이터에 대한 정확도를 출력하고 프로그램을 종료

if latest_ckpt:

ckpt.restore(latest_ckpt)

print("테스트 데이터 정확도 (Restored) : %f" % compute_accuracy(CNN_model(x_test)[0], y_test))

exit()실행코드 중 이 if문의 마지막 exit() 함수로 인해서 다시 실행하면 이전 학습했던 상태까지의 정확도를 측정한 후 프로그램이 종료됨을 알 수 있다.

'Study > Deep Learning' 카테고리의 다른 글

| Fine-Tuning(Transfer Learning) (0) | 2021.10.18 |

|---|---|

| TensorBoard 이용하기 (0) | 2021.10.18 |

| 드롭아웃(Dropout) (0) | 2021.10.17 |

| TensorFlow 2.0을 이용한 MNIST 숫자분류를 위한 CNN 구현 (0) | 2021.10.17 |

| CNN(Convolutional Neural Networks) (0) | 2021.10.17 |